Um estudo levado a cabo pelo Computer Science and Artificial Intelligence Lab do MIT (Massachusetts Institute of Technology) mostra que sistemas de inteligência artificial já conseguem enganar a perceção sonora dos seres humanos, depois de outras experiências terem já provas dadas no campo das fotos e da criação de carateres, por exemplo, diz o site Engadget.com.

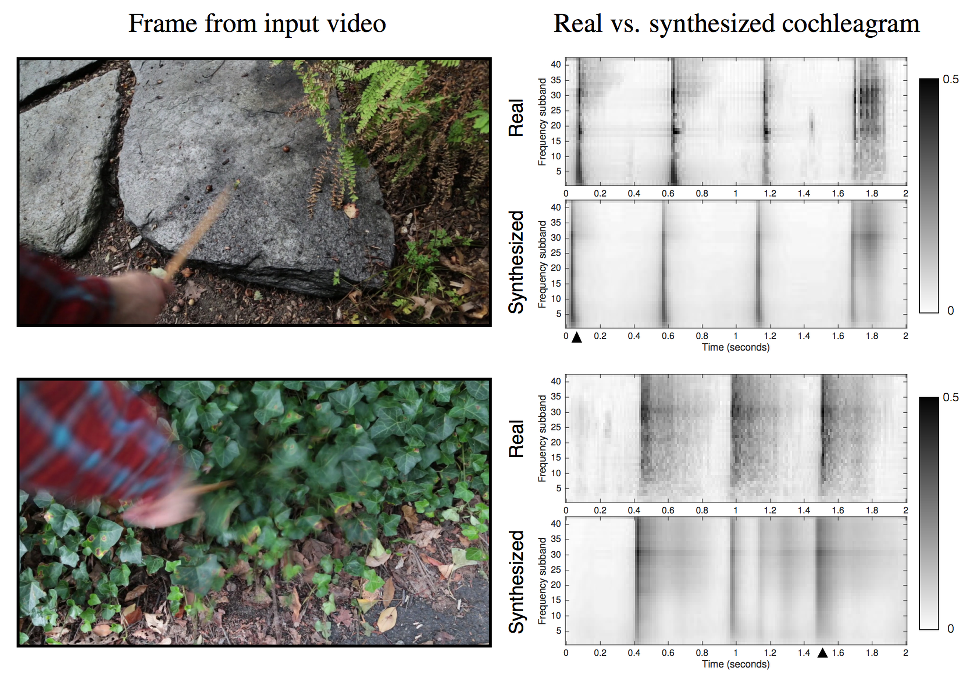

O algoritmo foi criado em computador consegue prever o som produzido por objetos, pessoas e outros elementos, assente numa base de dados gerada pela gravação de 978 vídeos e mais de 46 mil sons distintos, que incluem os que são causados por objetos a serem raspados, atingidos, partidos e tocados com uma baqueta semelhante às de uma bateria, o instrumento musical.

O mesmo sistema pode assim analisar vídeos sem som e prever as reações acústicas do que está a acontecer nas imagens, reproduzindo depois os sons corretos e realistas em função disso e de forma completamente autónoma. E este lote de sons comtempla interações com materiais como madeira, metal, terra e folhas, entre outros elementos.

Nos testes, as pessoas observavam dois vídeos – um com o som real e outro com o som simulado pelo algoritmo – e faziam a sua escolha. E a quantidade de seleções de sons gerados por inteligência artificial foi duplamente superior às de sons reais…

O resultado das experiências mostra que um algoritmo deste género pode contribuir para um forte avanço na área da inteligência artificial, como é exemplo a capacidade de um robot conseguir avaliar e interagir com o ambiente em seu redor. “Com base nestas informações, um autómato poderá olhar para um passeio e saber o que acontece quando pisamos pedra ou quando pisamos relva, pois o som é uma das primeiras etapas de previsão das interações físicas com o meio ambiente”, afirma Andrew Owens, um dos responsáveis do Computer Science and Artificial Intelligence Lab.

O mesmo laboratório do MIT que conduziu este estudo tem no seu portfólio muitos outros projetos experimentais, como é exemplo a iniciativa na área da cibersegurança que o TeK noticiou há algumas semanas.

[caption] [/caption]

[/caption]

Pergunta do Dia

Em destaque

-

App do dia

Treinar de forma mais inteligente e não mais difícil com o Impakt AI Coach -

Site do dia

O que é que posso fazer com a Inteligência Artificial hoje? -

Multimédia

NASA lança uma espécie de “corrida mais louca do mundo” mas para rovers lunares -

How to TEK

Como separar (ou juntar) as contas do Facebook e Instagram

Comentários